在3D 重建这个一直被视为“硬骨头”的 AI 领域,苹果公司刚刚秀出了一项足以改变游戏规则的黑科技。

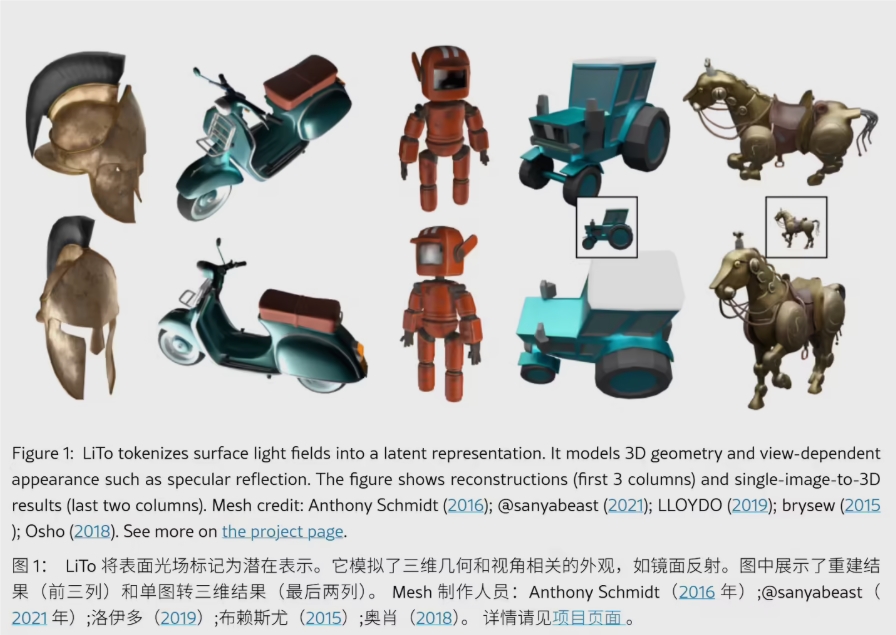

据最新报道,苹果AI 研究团队发布了一项名为 LiTo(表面光场标记化) 的最新模型。它的核心突破在于:仅凭一张普通的2D 平面图像,就能重建出完整的3D 对象,且细节还原度达到了物理级别的真实感。

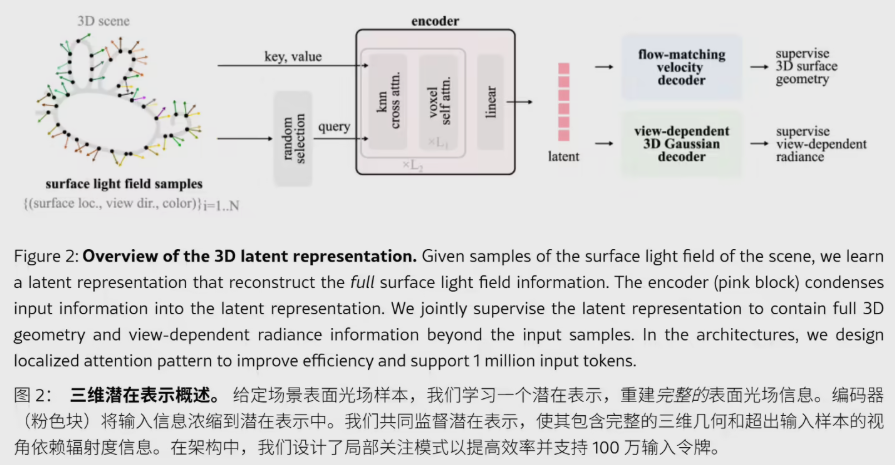

长期以来,单图生成3D 模型最大的痛点在于“光影的一致性”。当你旋转视角时,物体表面的反射、高光往往会变得扭曲或失真。而LiTo模型通过引入创新的“潜在空间”(Latent Space)表示法,成功攻克了这一难题。它不再是死记硬背像素,而是通过数学向量掌握了光线与表面交互的底层规律。

简单来说,LiTo具备了极强的“脑补”能力。哪怕只有一张正面照,它也能精准预测出物体背面在不同光照条件下的镜面高光和菲涅尔反射。在官方公布的对比测试中,LiTo在多视角光影还原度上,已经显著超越了目前行业领先的 TRELLIS 模型。

为了打磨这个“细节控”AI,研究人员使用了数千个3D 对象,在150个视角和3种光照条件下进行了高强度训练。这种对光影近乎偏执的追求,显然是在为空间计算生态铺路。

想象一下,未来你只需用 iPhone 拍一张照片,LiTo就能瞬间将其转化为一个栩栩如生的3D 模型,并无缝置入 Vision Pro 的虚拟空间中。这种从2D 内容到3D 资产的极简跨越,或许正是苹果在 AI 赛道上实现“后发制人”的关键杀手锏。

© 版权声明

本网转发此文章,旨在为读者提供更多信息资讯,只用于分享,不做任何商业用途,版权归原作者所有。由于条件所限,在转载之前无法与所有权利人联系授权,可能出现部分原创图片或文字未署名,请联系添加。如有侵权,请联系删除处理。

相关文章

暂无评论...